Signaler de manière trop ouverte les fausses nouvelles ou « false news » (« fake » a un sens trop politisé, l’avis de Facebook est impartial) aurait un effet contreproductif selon Facebook. Le réseau social a annoncé être revenu sur la politique qu’il avait mise en place il y a exactement un an, en décembre 2016. Non seulement le petit triangle avertisseur rouge, accolé aux informations jugées erronées, n’a pas empêché les clics, mais il les aurait favorisés !

Première leçon de cette histoire : les gens n’entendent pas vraiment qu’un gendarme leur impose sa façon de penser.

Exit le petit triangle avertisseur rouge

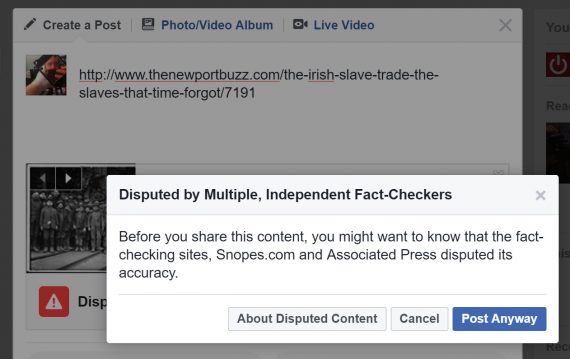

C’était l’une de ses premières mesures pour lutter contre la propagation de fausses informations. Ce dispositif permettait aux utilisateurs de signaler des contenus douteux, lesquels étaient ensuite vérifiés par des médias partenaires de la plate-forme : les articles reconnus comme problématiques étaient signalés aux internautes par une mention « contesté par… » et un pictogramme d’alerte rouge.

Mais le petit triangle avertisseur a eu, selon les déclarations du groupe, « l’effet inverse de ce que nous voulions » : « La recherche universitaire sur la correction de la désinformation a montré que mettre une image forte, comme un drapeau rouge, à côté d’un article peut en réalité ancrer des croyances plus profondément ». Et enfermer les gens dans leurs opinions…

Le plus étonnant, c’est quand même que Facebook ait cru, un seul instant, que les utilisateurs obtempéreraient à son statut de détenteur de la vérité, une plate-forme qui ne représente aucune autorité, ni religieuse, ni politique, et qui vit de recettes publicitaires… ! C’en est presque risible. La logique voulait que ça conforte évidemment les rebelles et que ça rende curieux les autres…

Alors Facebook arguera qu’il confiait la contestation de l’information à des « contrôleurs d’informations tiers », des « organismes vérificateurs tiers », des médias spécialisés dans la vérification. Mais il se les choisissait. Et en France, c’était évidemment le journal Le Monde.

La contextualisation made by Facebook

Alors que reste-t-il au réseau, si sourcilleux de cette « intégrité » qu’il juge supérieure à ses intérêts financiers, dixit Mark Zuckerberg ? ! Une mise en contexte, plus douce mais plus sournoise, qui fournira automatiquement d’autres informations, toujours « choisies », en regard de celles jugées « fausses ».

En effet, même si la présence d’articles connexes n’empêche en rien les clics, elle diminue sensiblement le nombre de partages, selon les tests menés par le personnel de la plate-forme. Et puis, elle tend néanmoins à « réduire les perceptions erronées ».

Influencer de manière à ce que l’utilisateur pense toujours mener son propre raisonnement, sans trop se voir imposer quoi que ce soit – ça passe logiquement mieux.

« Empêcher les gens de lire de fausses nouvelles (fake news) s’avère plus difficile que prévu »

Et si ça reste trop dangereux, même en contextualisant, il y a toujours la censure. Facebook se réserve le droit de supprimer les pages qui contreviendraient à la politique de la maison, celles qui forcent leur publicité par le vol des « like » ou le rachat-fusionnage d’autres pages, mais aussi celles qui diffusent des informations jugées erronées : un article du Monde a recensé ainsi récemment 147 pages supprimées ou suspendues de la plate-forme (environ 12 % de celles que leur enquête avait identifiées) : des pages qui cumulaient plus de 50 millions de fans…

112 d’entre elles diffusaient surtout des contenus sensationnalistes. Mais plus de vingt autres étaient des pages politiques, « essentiellement d’extrême droite, comme celles d’Alain Soral et de son site Egalité et Réconciliation ». Souvenons-nous que la page Facebook de Reinformation.tv a été fermée pendant plusieurs mois d’affilée sans qu’aucune raison ne nous soit avancée…

Quant aux pages non souhaitées, mais pas censurables directement, Facebook utilise d’autres armes, comme la réduction de visibilité : les articles rétrogradés perdent généralement 80 % de leur trafic. Facebook bloque également les publicités dans des applications ou des sites dont le contenu serait « illégal, trompeur ou mensonger ». Un grand nombre de réseaux pro-vie en ont pâti : de ceux-là Facebook veut particulièrement assécher les revenus publicitaires…. Le site en ligne LifeSite peut en témoigner !